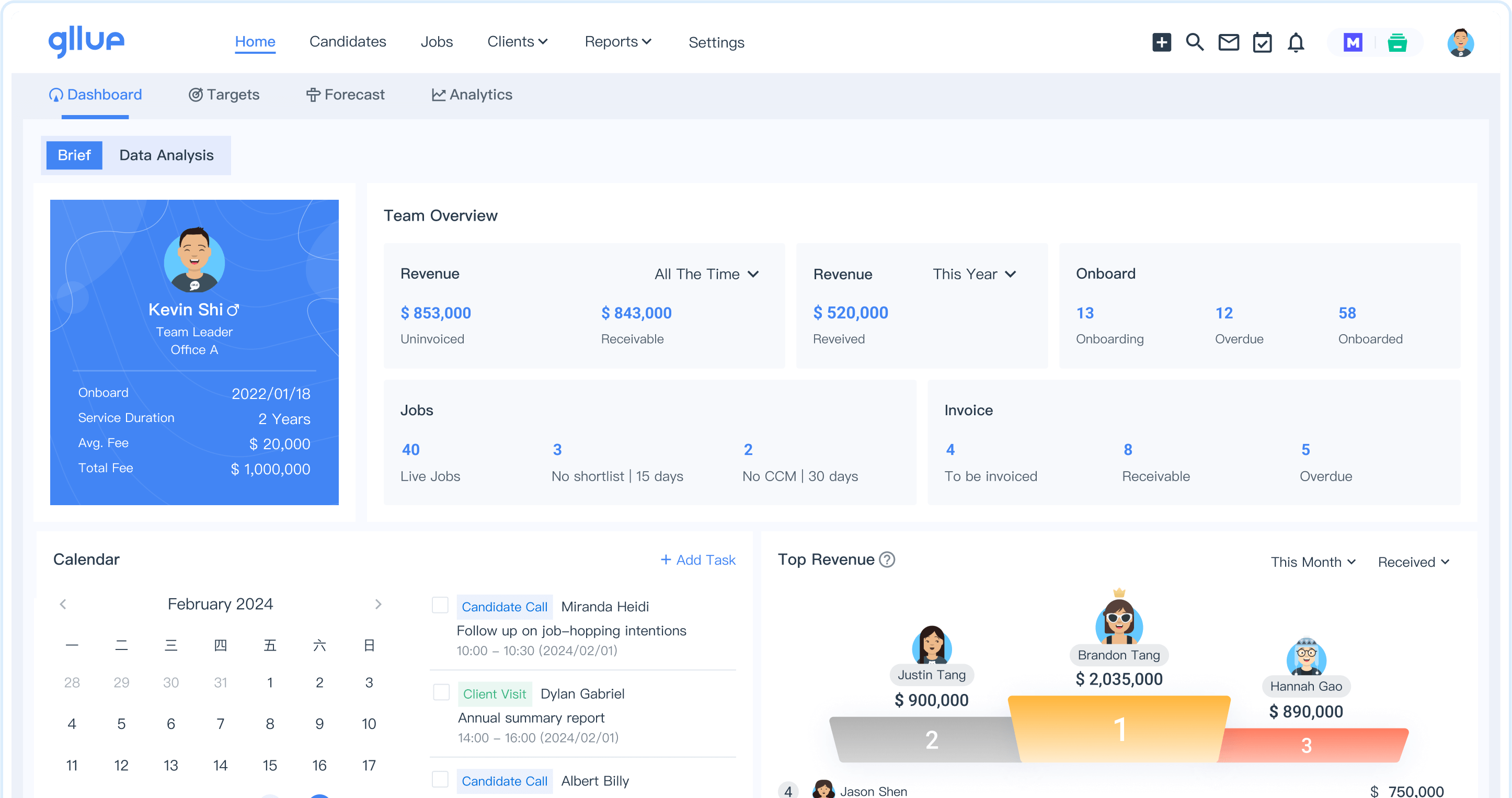

Gllue - The powerful ATS/CRM tailored for recruiters

Dedicated to empowering headhunters, crafted for your success

Gllue is the comprehensive software solution for recruitment agencies, trusted by over 30,000 recruiters worldwide.

Exploring Gllue core capabilities

Sourcing

Gllue empowers you to explore diverse resume sources and establish a dynamic talent pool, our platform is designed to shorten talent keyin and search duration while enhancing the success rate .

Candidate Relationship Management

Recruitment CRM for agencies of all sizes, this is your core system of truth designed for transformative recruitment success.

Applicant Tracking System

Recruitment ATS for agencies of all sizes, this is your core system of truth designed for transformative recruitment success.

Product Localization

We've meticulously tailored our localization efforts for areas like Singapore, Hong Kong, and Taiwan, encompassing extensive support for English, Traditional Chinese, and Simplified Chinese. This also includes aligning with the predominant recruitment channels of these regions for optimal integration.

Security

Safeguarding your valuable business data with robust security measures. Our powerful data permission management includes watermarks, browser fingerprinting, two-factor authentication, advanced password policies, IP access control, and data access limitations for comprehensive protection.

Distinctive Features and Innovations

Gllue Mapping

A proactive recruitment powerhouse, integrating mind mapping tools into the ATS. By vividly presenting the corporate organizational structure, it aids in efficient business development and enhances the ability to search for and maintain candidates.

Gllue Copilot

AI Assistant for Headhunters, focused on enhancing the productivity of recruitment personnel. Our aim is to significantly reduce the time spent on manual tasks and elevate the working capacity of your team, ensuring greater efficiency across the board.

Forecast

With the Forecast tool, you can scientifically predict expected revenue for upcoming periods. This versatile tool supports various forecasting models, offers easy input methods, and provides multi-dimensional visual analysis charts to enhance your strategic planning and decision-making.

Invoicing

The financial module, deeply integrated with Gllue’s ATS module, is designed to facilitate collaboration between recruitment consultants and internal finance teams. It supports functionalities like sending invoices, marking payments received or refunds, and offers report analysis tools to closely monitor the performance achievements of recruitment consultants.

BI/Analytics

A BI tool tailored for headhunting business scenarios, offering powerful and easy-to-understand real-time reports and data insights. Deeply integrated with Gllue’s foundational business data, it ensures thorough and accurate reporting capabilities.

Trusted by the 2,000+ recruitment firms worldwide

Whether you are formulating recruitment strategies or managing a talent pool, we believe this tool will become an indispensable assistant. Try it now and embark on your journey to efficient recruitment!